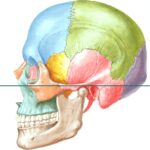

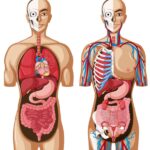

Publicado enAnatomía

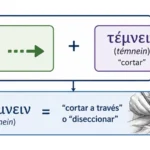

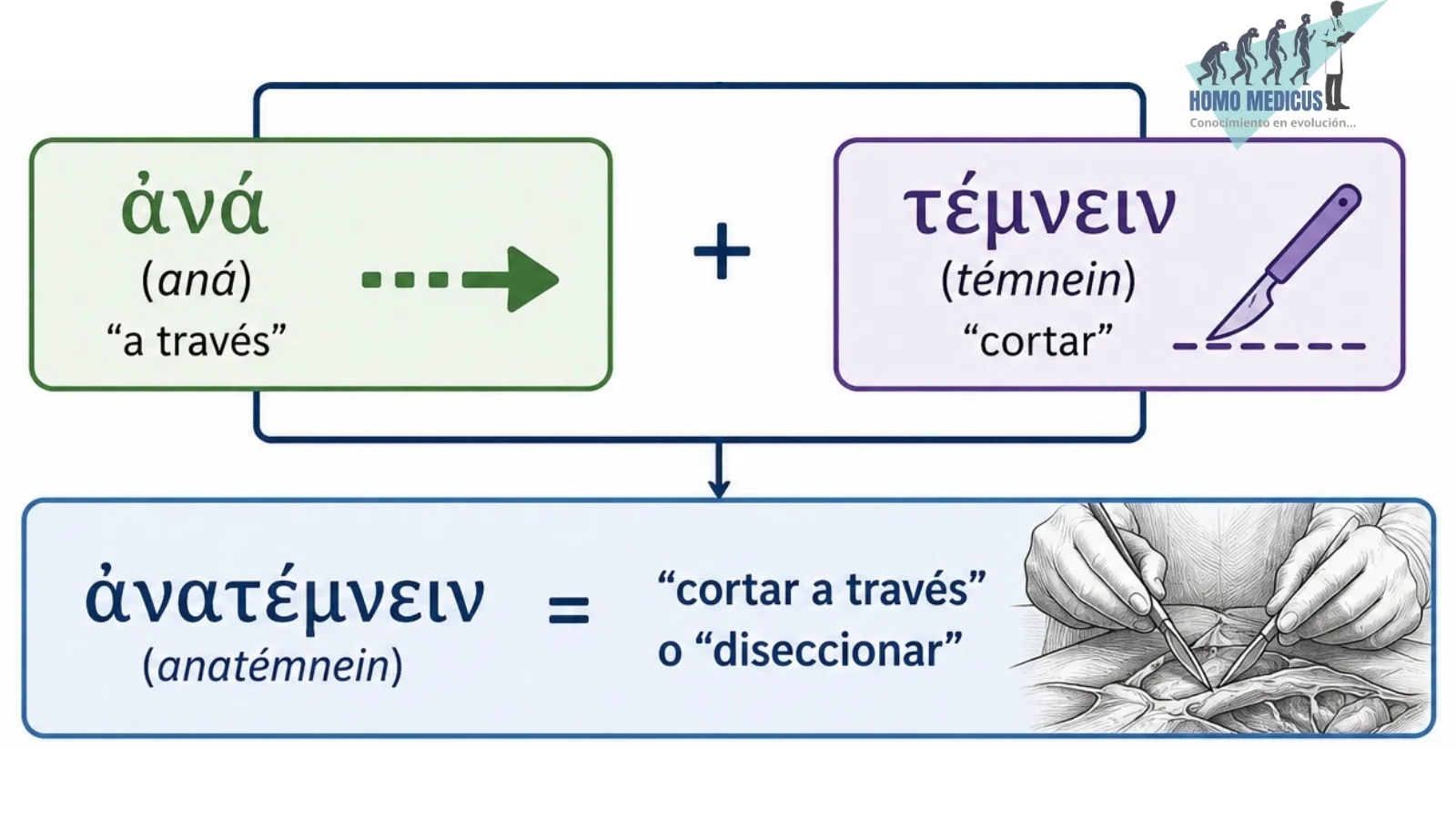

Significado de la palabra anatomía

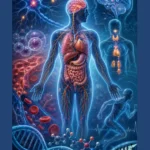

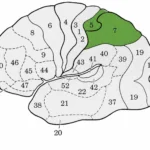

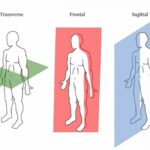

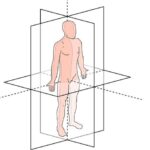

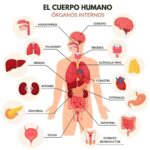

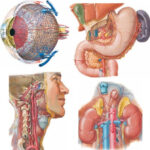

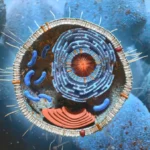

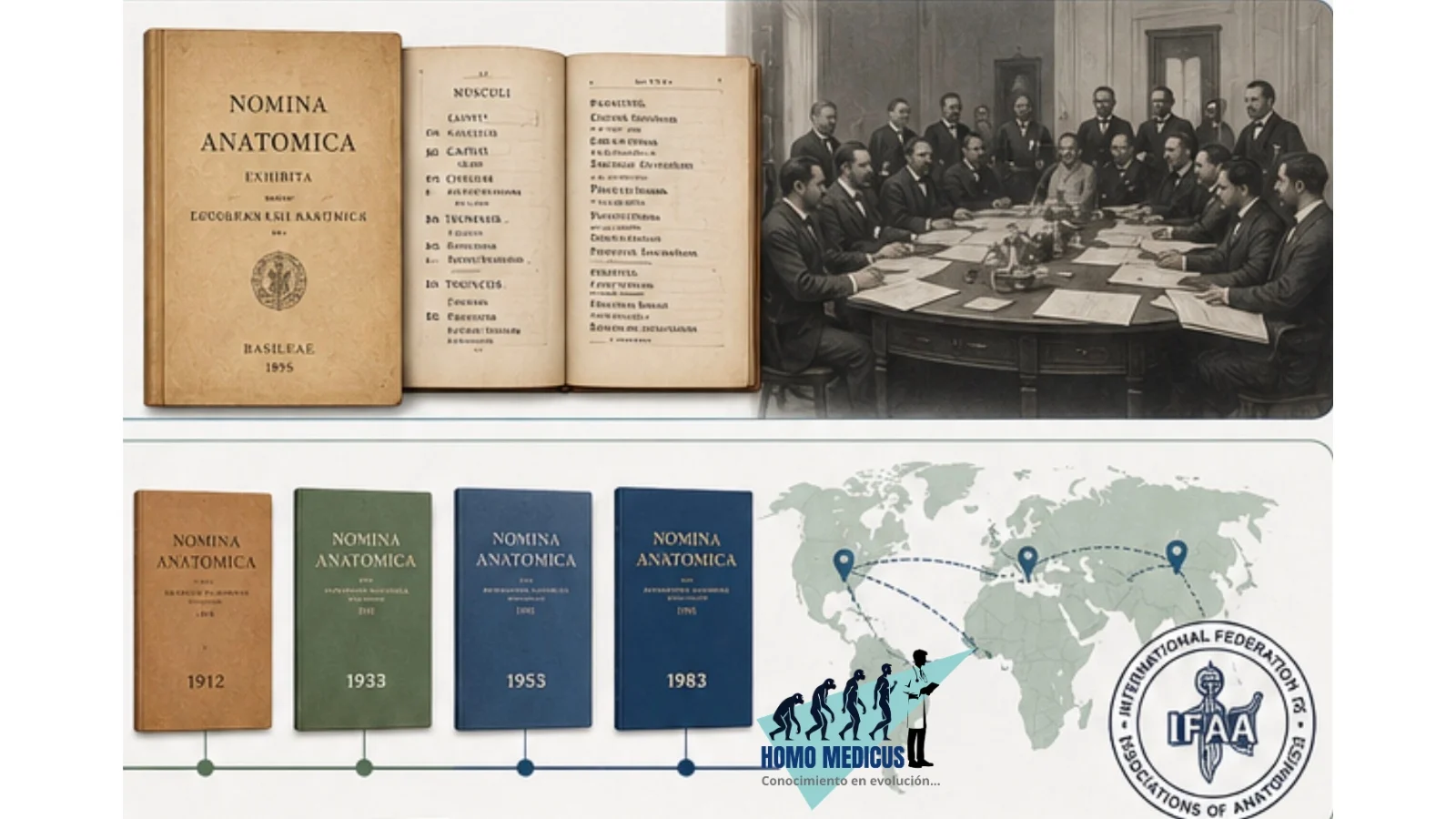

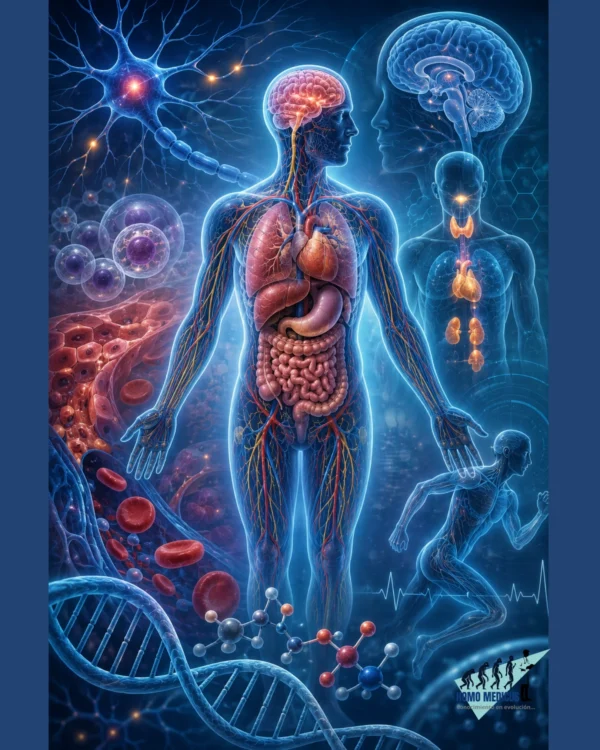

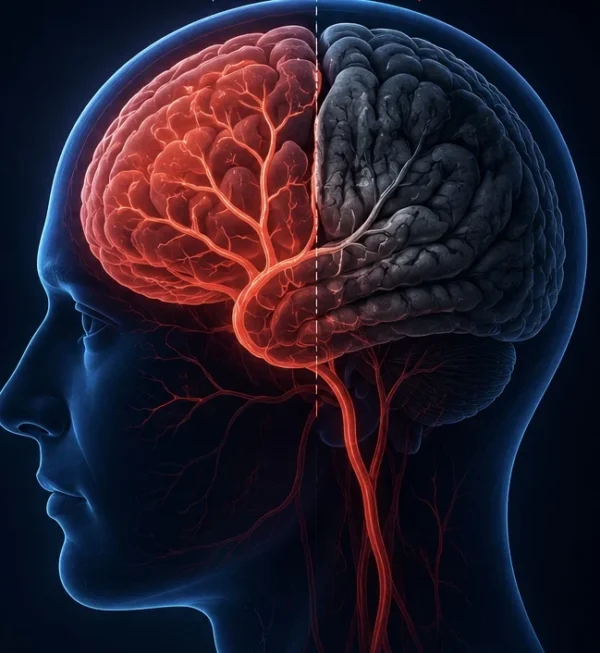

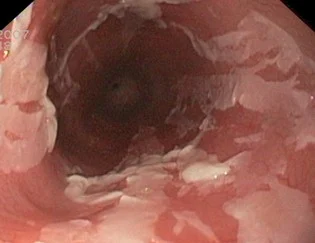

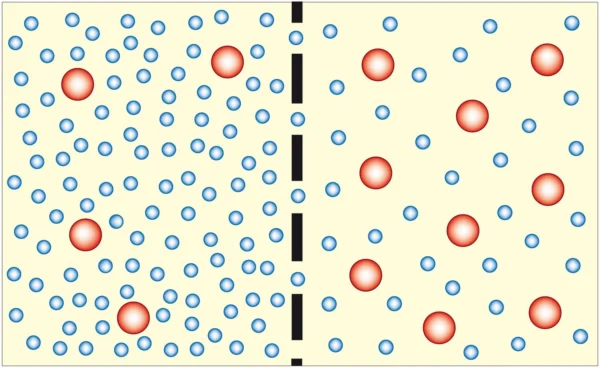

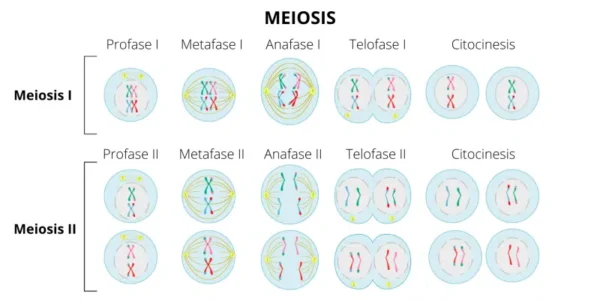

La anatomía se define como la disciplina científica encargada del estudio de la estructura morfológica de los organismos vivos, así como de la organización, disposición, relaciones espaciales y características físicas…